Jensen Huang, le patron de Nvidia, a l’habitude de sortir les grands mots à chaque conférence. Cette fois, il parle carrément de « l’ère de la robotique généraliste ». Ce qu’il veut dire : avec GR00T N1, les robots humanoïdes sont censés devenir beaucoup plus flexibles, plus autonomes… et plus utiles.

Un modèle pour des robots plus malins

GR00T N1, c’est un modèle fondation — un système d’IA préentraîné — qui peut servir de base à des robots capables d’effectuer des tâches variées. Le modèle s’inspire du cerveau humain avec deux « systèmes » complémentaires. Le premier (System 1) est rapide et réactif, un peu comme des réflexes. Il est capable d’exécuter des mouvements précis en temps réel, comme attraper un objet ou déplacer un carton. Le deuxième (System 2) prend un peu plus de temps pour réfléchir. Il analyse l’environnement, comprend les consignes et planifie les actions à réaliser. Ensuite, il transmet le plan au premier système pour que le robot passe à l’action.

La bonne nouvelle, c’est que GR00T N1 est personnalisable. Les développeurs peuvent le compléter avec leurs propres données, issues d’expériences réelles ou de simulations, pour adapter les comportements du robot à des situations spécifiques.

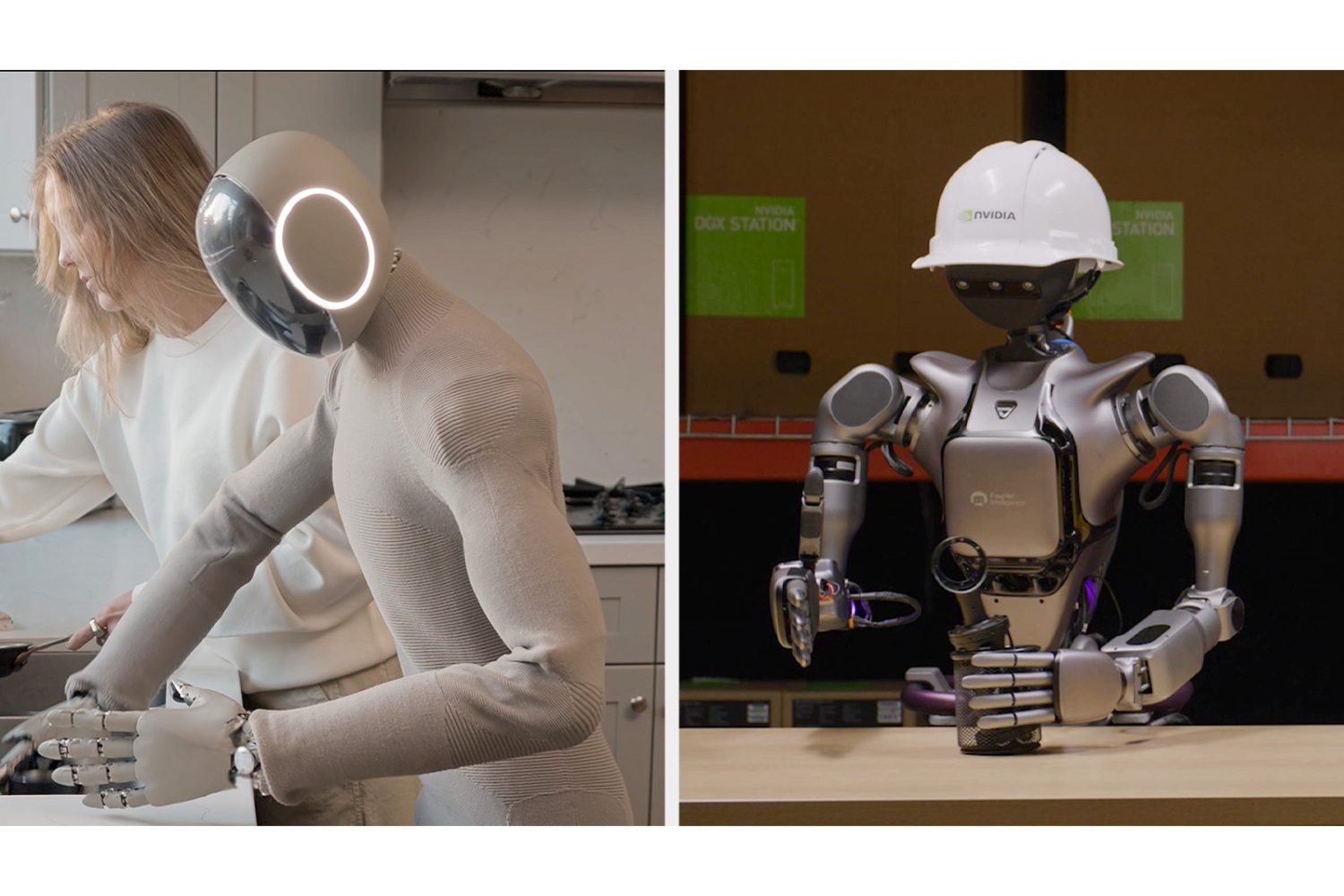

Plusieurs entreprises ont déjà mis la main sur GR00T N1 pour leurs propres robots. C’est le cas de Boston Dynamics (les créateurs du robot Atlas), Agility Robotics, Mentee Robotics ou encore Neura Robotics. Mais c’est surtout 1X Technologies qui a fait le show pendant la conférence GTC 2025 avec son robot NEO Gamma. Ce dernier a été montré en train de ranger une pièce tout seul, grâce à GR00T N1 et un léger entraînement supplémentaire.

« On développe nos propres modèles, mais GR00T N1 nous a clairement fait gagner du temps », explique Bernt Børnich, le CEO de 1X. « Notre robot devient plus qu’un simple outil : c’est un vrai assistant capable d’interagir avec les humains. »

Pour enrichir encore l’apprentissage des machines, Nvidia mise aussi sur la simulation. Grâce à un outil appelé GR00T Blueprint, la société est parvenue à générer en 11 heures l’équivalent de neuf mois de gestes humains en données synthétiques. Ce gain de temps permet aux robots de s’entraîner virtuellement avant de passer à la réalité.

Nvidia travaille également sur Newton, un moteur physique open source développé avec Google DeepMind et Disney Research. Objectif : rendre les simulations encore plus réalistes. Disney compte d’ailleurs s’en servir pour ses futurs robots de divertissement, comme les droïdes de Star Wars.

Les fichiers, les données et les outils sont déjà disponibles sur GitHub et Hugging Face. De quoi alimenter les futurs robots de service, de logistique ou même d’accueil.

🟣 Pour ne manquer aucune news sur le Journal du Geek, abonnez-vous sur Google Actualités et sur notre WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.