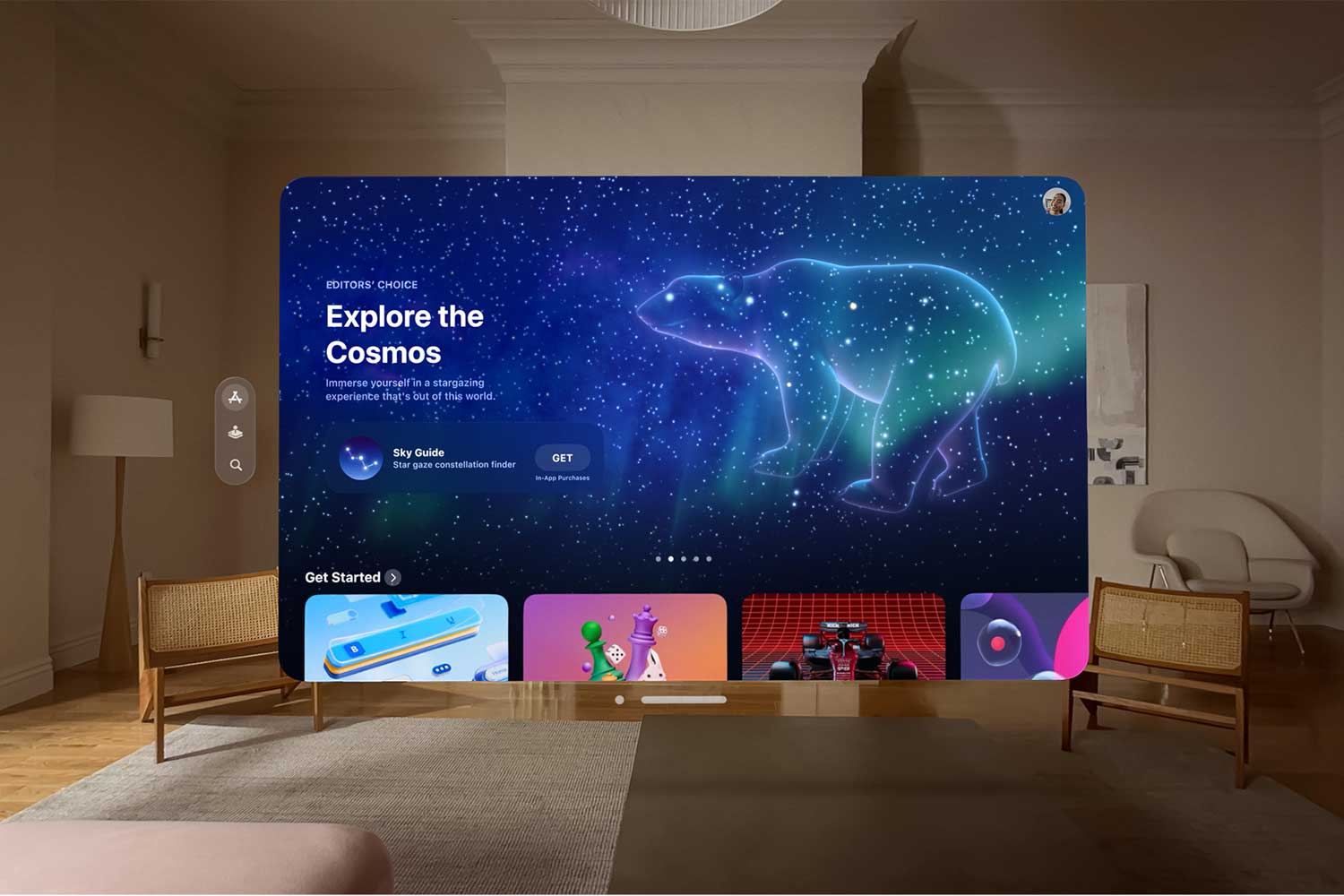

L’Apple Vision Pro est plus impressionnant techniquement que réellement inutile, et le premier casque de réalité mixte de la Pomme semble trop en avance sur son temps. Présents au salon CP+ de Yokohama au Japon, les responsables de Canon ont échangé avec le site spécialisé PetaPixel. L’occasion pour eux d’évoquer des thèmes comme la 3D, la réalité virtuelle ou la réalité augmentée.

Ces sujets intéressent les fabricants d’appareils photo, toujours à la recherche d’un second souffle pour contrer la baisse des ventes. Ils voient une nouvelle opportunité et la possible création d’un nouveau marché, celui des systèmes de caméra taillés pour créer des contenus immersifs à un casque comme le Vision Pro. Et le sujet est de taille, puisque Canon estime qu’il n’existe actuellement pas de caméras en mesure de gérer la définition et le taux de rafraîchissement du casque d’Apple.

Le géant japonais de la photo fait pourtant des efforts, comme en témoigne le lancement de l’objectif RF 5.2 mm F2.8L Dual Fisheye à la fin de l’année 2021. Le hic, c’est que cela ne suffit pas pour proposer du contenu adapté au Vision Pro. Selon Canon, il faudrait disposer de caméras de 100 mégapixels capables de tourner à 60 images par seconde pour offrir un rendu convaincant depuis le casque.

Canon confirme l’incapacité des caméras actuelles à capturer une image adaptée

Il est pour l’heure très difficile d’associer un tel taux de rafraîchissement avec une définition aussi élevée. En effet, cela équivaut à une vidéo en 14K qui surpasse les 8K disponibles sur le haut de gamme. Dans les faits, il existe un dispositif capable de répondre à ces exigences (et même d’aller encore plus loin) : la « Big Sky ». Cette dernière n’est autre que la caméra de la fameuse Sphere de Las Vegas, capable de tourner en 18K à 60 i/s. Un véritable monstre qui coûte des millions de dollars et nécessite 12 personnes pour fonctionner. Un dispositif totalement inadapté.

« Pour l’instant, Canon ne peut pas répondre à ce niveau d’exigence », explique Yasuhiko Shiomi de Canon. Go Takura, directeur général et directeur adjoint de l’imagerie chez Canon, tempère en précisant que « techniquement, théoriquement, nous pouvons le faire ». Le principal problème auquel fait fasse la marque est qu’il lui faut proposer « des produits qui peuvent être commercialement viables » et « dont le prix peut être suffisamment abordable pour que les clients puissent les acheter ».

Une situation qui demande du temps et Canon reconnaît qu’il lui faut peaufiner sa technologie pour proposer un outil adapté. L’autre élément à prendre en compte et qu’il faudra des solutions de stockage adaptées. Oubliez votre carte SD, une vidéo enregistrée avec la caméra 18K de la Sphere pèse 32 Go… par seconde. Une séquence d’une minute atteint les 2 To et il faut stocker 115 To pour une heure de vidéo.

🟣 Pour ne manquer aucune news sur le Journal du Geek, abonnez-vous sur Google Actualités et sur notre WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.

Donc la pleine résolution de l’applevision est inutile en vidéo, car il faudrait qu’il puisse géré le h266 en décodage natif à 14k optimisé on devrait pouvoir descendre entre 5 et 10gb par seconde, si la sphère fonctionne en h265 et entre 2 et 4go si elle fonctionne en h264.

Entre les 2 si elle fonctionne en AV1.

Malheureusement ce ne sera pas avant 2025 à 2028 que les puces commenceront à géré le h266.

Peut être le Apple M4 ou M5.

Après si il est assez puissant pour upscale de la 8k cela devrait être propre déjà.