La prolifération des images générées par l’IA pose de plus en plus de problèmes éthiques. Il faut dire que les progrès technologiques survenus ces derniers mois rendent de plus en plus difficile l’identification d’une deepfake. Les exemples se sont d’ailleurs multipliés ces derniers jours, à travers la publication d’une photo du Pape en doudoune XXL, ou d’un manifestant âgé violenté par les forces de l’ordre au milieu des manifestations. Récemment, c’est une photo de Julian Assange très affaibli qui a fait le tour des réseaux sociaux.

Face des images de plus en plus réalistes, des solutions existent pourtant pour reconnaître des productions générées par MidJourney, Stable Diffusion ou encore Dall-E. Ceryains détails incohérents par exemple, ne trompent pas.

Les mains

Le premier indice pour déterminer l’authenticité d’une image réside dans les mains de son sujet. MidJourney a beau être de plus en plus efficace sur la question du photoréalisme, il gère encore mal certains détails complexes. Il suffit généralement de s’attarder sur le nombre de doigts, leur position ou encore leur comportement par rapport à des objets pour déceler une image artificielle d’une photo naturelle.

Sur la photo du Pape en doudoune par exemple, on pouvait apercevoir que la main droite du souverain pontife était trop petite, et qu’elle portait un gobelet de café sans même le toucher. Sur une autre image à la plage, le rendu n’est pas beaucoup plus réaliste, puisqu’il affiche six doigts de pied, et seulement quatre à la main gauche. De son côté, l’image d’Emmanuel Macron forcé à manger de la boue possède sept doigts à la main gauche.

Les uniformes

Autre détail sur lequel s’attarder pour démêler le vrai du faux : les vêtements, et plus particulièrement les uniformes. Sur bon nombre de photos montrant les manifestations en France, ou l’arrestation de Donald Trump aux États-Unis, les tenues règlementaires des policiers ne correspondent à rien. Pire encore, ces dernières sont parfois complètement incohérentes. Le constat est d’autant plus flagrant sur les couvre-chefs. On retrouve ainsi parfois des casques qui s’arrêtent au milieu du crâne, ou des chapeaux incohérents face à la situation.

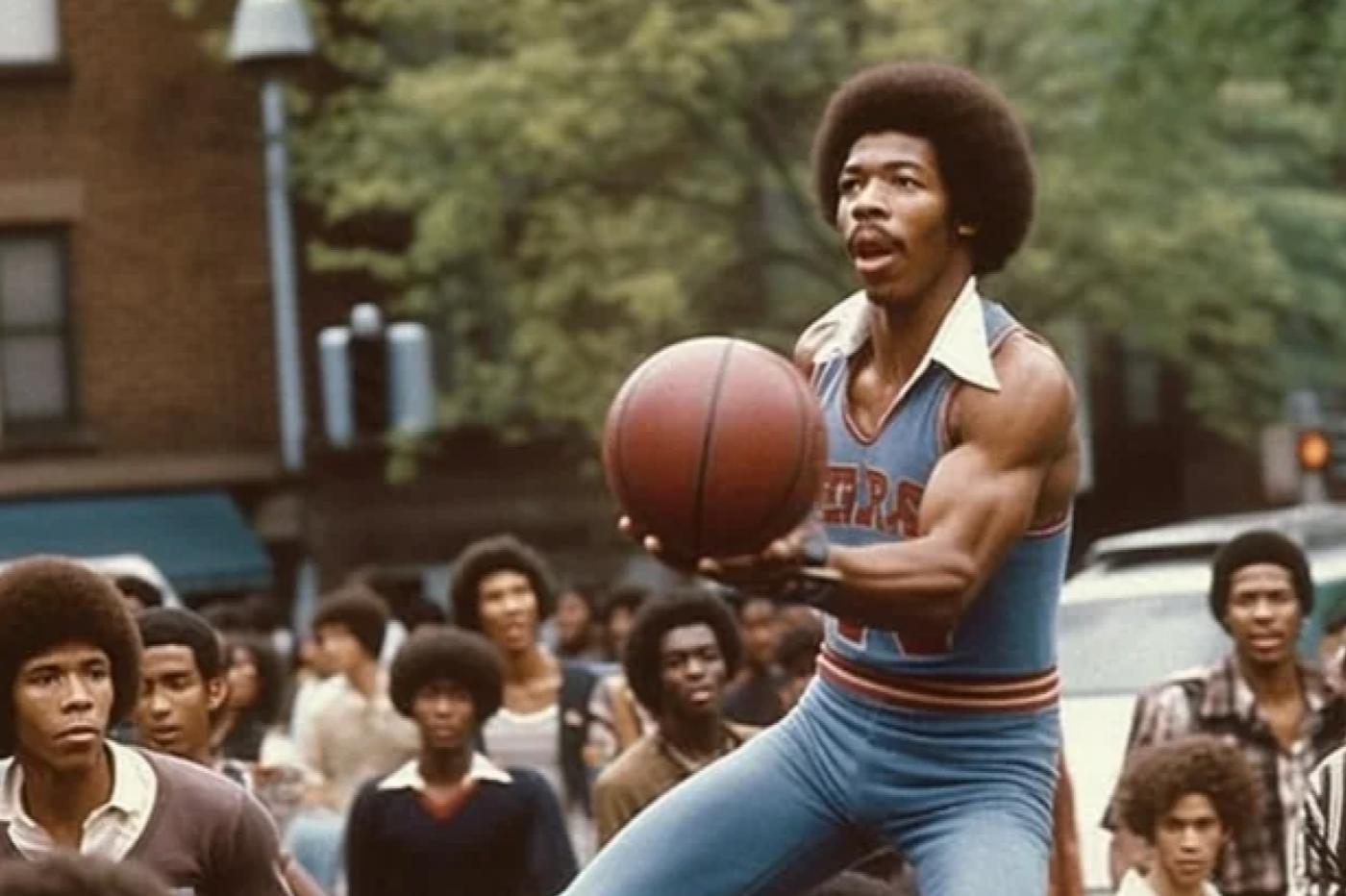

Les corps déformés

Les positions du corps aussi ont leur importance. MidJourney gère de mieux en mieux la perspective, mais il n’est pas rare de voir des corps déformés, des contorsions impossibles et des membres atrophiés. Si certaines proportions sont difficiles à déceler, d’autres sautent aux yeux, et devraient facilement vous mettre la puce à l’oreille.

Les objets qui n’existent pas

Qu’il s’agisse d’une soucoupe volante, d’une architecture irrégulière ou d’une chaise avec plus de pieds que la normale, MidJourney a souvent tendance à imaginer des objets de toutes pièces. C’est notamment le cas de cette platine tout droit sortie des années 1980, qui ressemble à un étrange mélange entre un équipement audio et une gazinière.

Des textes incohérents

Comme dans un rêve, les textes générés par l’IA sont le plus souvent très approximatifs. Il faut dire que si MidJourney est plutôt efficace quand il s’agit de comprendre du texte, les choses deviennent plus compliquées quand il s’agit d’écrire. À première vue, rien ne cloche, mais les textes générés artificiellement s’imposent souvent comme des accumulations de glyphes illisibles ou vides de sens.

Évidemment, ces détails sont à prendre en compte de manière très court-termisme. D’abord parce qu’une image qui n’intègre aucune de ces incohérences ne peut pas être de facto validée comme une photo authentique. Ensuite parce que les progrès de MidJourney et de ses consœurs sont tels que les plateformes d’IA devraient très vite corriger le problème. Dans tous les cas, il va falloir se montrer encore plus prudent quant à ce qui circule sur les réseaux sociaux.

🟣 Pour ne manquer aucune news sur le Journal du Geek, abonnez-vous sur Google Actualités et sur notre WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.