Avec l’essor actuel de l’intelligence artificielle, les deepfakes – ces trucages numériques basés sur l’intelligence artificielle qui remplacent la voix ou le visage d’une célébrité dans un extrait vidéo ou audio – représentent une source d’inquiétude légitime; ils sont désormais si convaincants que bien souvent, un être humain lambda n’est même plus en mesure de faire la différence (voir notre article).

Cette situation a conduit certains grands noms de l’intelligence artificielle à développer des programmes spécialisés dans la détection de ces deepfakes. Aujourd’hui, c’est au tour d’Intel de présenter ses avancées dans ce domaine; la firme américaine vient de déclarer que son programme baptisé FakeCatcher était capable d’identifier la quasi-totalité des deepfakes vidéo, et ce en temps réel – une évolution considérable par rapport aux autres systèmes actuels.

S’il est aussi performant, c’est parce qu’il se base sur une méthode assez différente des algorithmes de détection traditionnels. Généralement, ces derniers décortiquent les données brutes qui composent la vidéo, sans vraiment s’intéresser à la succession des images à proprement parler. FakeCatcher, en revanche, utilise une approche basée sur la photopléthysmographie.

https://www.youtube.com/watch?v=1Whp-XxmZnk

Un système basé sur la circulation du sang

Ce terme alambiqué désigne une méthode d’exploration vasculaire non invasive. Elle consiste à éclairer un tissu vivant, puis à mesurer la quantité de lumière réfléchie ou absorbée par les vaisseaux sanguins et leur contenu. On peut alors en tirer des informations sur la circulation sanguine.

C’est grâce à cette technique que certains appareils, comme les montres connectées, sont capables de déterminer votre fréquence cardiaque. Les chercheurs d’Intel, de leur côté, ont eu l’idée d’utiliser ce concept dans le cadre de la chasse aux deepfakes.

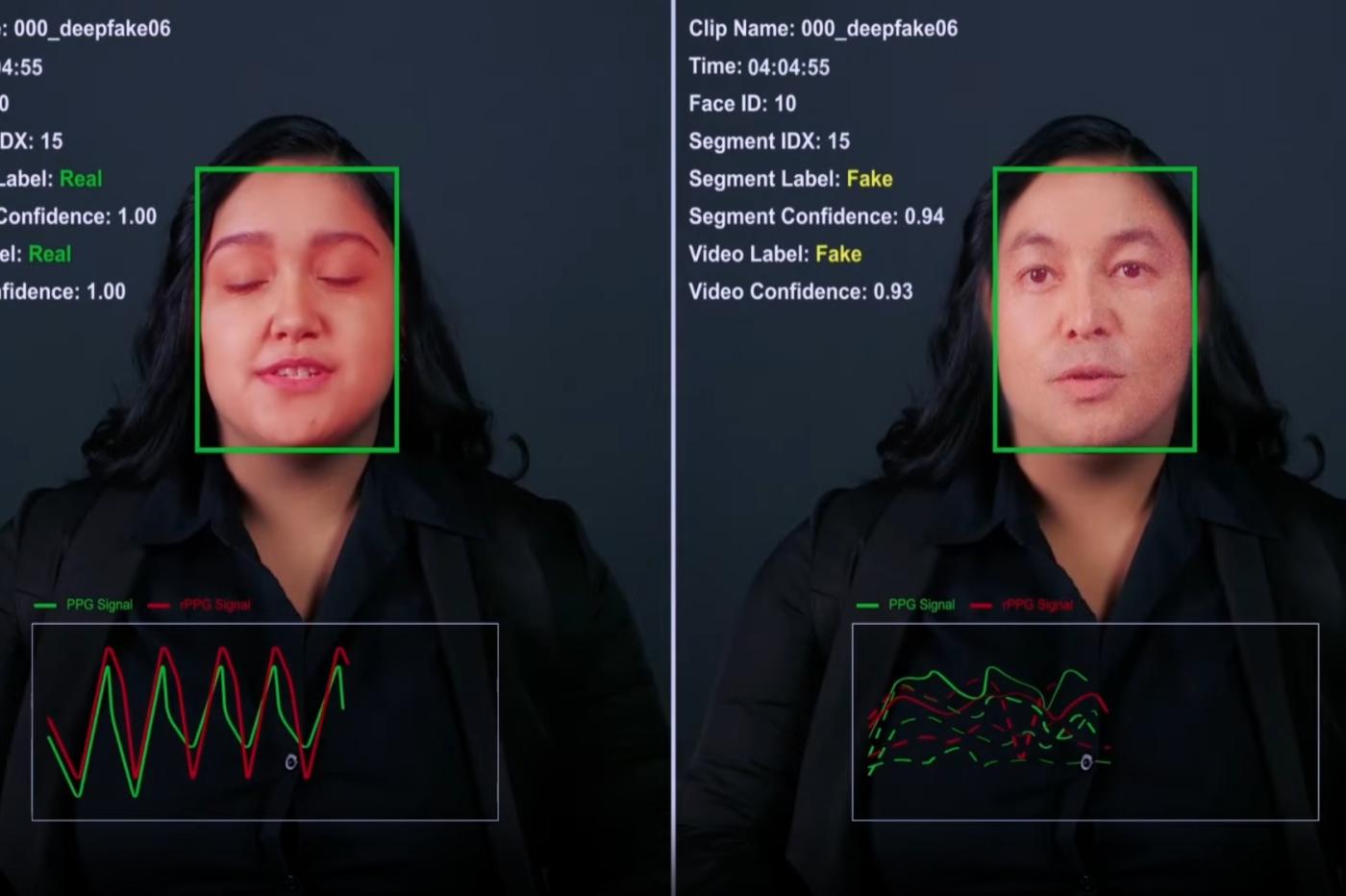

À l’aide d’outils algorithmiques très élaborés, il est possible de repérer de minuscules variations de teinte, indétectables pour l’œil humain, qui sont directement liées à la façon dont le sang circule dans le visage. Mis bout à bout, toutes ces différentes constituent donc une sorte de signature unique. Cette dernière peut être synthétisée sous la forme d’une carte spatio-temporelle, qui décrit les changements de teinte en fonction du temps.

Or, les algorithmes de deepfake actuels sont pour l’instant bien incapables de reproduire ces changements excessivement subtils. Lorsqu’on cherche à utiliser cette approche sur une vidéo truquée, on obtient une carte qui présente des incohérences certes discrètes, mais très faciles à identifier pour un programme spécialisé basé sur l’intelligence artificielle. En pratique, cette carte est donc un gage d’authenticité qui permet de repérer les deepfakes avec une excellente précision.

Un programme performant… pour le moment

Les troupes d’Intel affirment que ce système fonctionne dans 96% des cas. Et ce qui rend ce chiffre encore plus impressionnant, c’est que contrairement à ce que suggère l’intuition, il est excessivement rapide; FakeCatcher a besoin de quelques millisecondes à peine pour identifier un deepfake. On peut donc parler de détection en temps réel, ce qui est une grande première dans ce domaine selon la firme. Cette vitesse de fonctionnement à permis à Intel d’héberger son programme sur un serveur standard accessible depuis le web. Une considération importante lorsqu’il s’agit d’utiliser un système de ce genre en conditions réelles.

Sa principale limite, c’est qu’il exploite le relatif manque de précision des deepfakes actuels. Plus les algorithmes qui permettent de les créer deviendront performants, plus les changements subtils – comme ces fameuses variations de teinte associées à la circulation sanguine – seront intégrés aux vidéos truquées. Cette approche ne fonctionnera donc pas indéfiniment; il va falloir continuer à trouver de nouvelles pistes pour différencier le vrai du faux… jusqu’à ce que les deepfakes progressent à nouveau. Et ainsi de suite.

C’est une dynamique comparable à celle qui oppose les pirates informatiques aux chercheurs en cybersécurité; nous assistons à une sorte de jeu du chat et de la souris sempiternel entre une technologie qui progresse à grande vitesse, et des humains qui tentent d’empêcher les dérives associées. Il conviendra donc de garder un œil sur ces rapports de force; car la dangerosité des deepfakes dépend directement des performances de ces systèmes de détection.

🟣 Pour ne manquer aucune news sur le Journal du Geek, abonnez-vous sur Google Actualités et sur notre WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.