Le mythique Minority Report de Philip K. Dick est une œuvre magistrale, avec son scénario centré autour d’un système prédictif qui permet d’appréhender les criminels avant même qu’ils ne passent à l’acte. Aujourd’hui, cette dystopie est confortablement installée dans l’imaginaire collectif grâce à Spielberg.

Llorsque le réalisateur l’a mise en images en 2002, soit près de 50 ans après la publication du livre, il a pris une autre dimension; à l’ère de la démocratisation de l’informatique, le film a remis au goût du jour un ensemble de problématiques qui semblent encore plus actuelles vingt ans après.

Dès qu’un système basé sur le machine learning s’attaque à des problématiques qui relèvent du maintien de l’ordre et de la justice, on voit immanquablement fleurir des références à ce film. Mais ces comparaisons ont rarement été aussi justifiées qu’en ce moment, surtout avec ces nouveaux travaux issus d’un laboratoire de l’Université de Chicago.

90% de précision, une semaine à l’avance

Dans les colonnes de Bloomber, ils ont en effet présenté un système qui semble terriblement proche du scénario de Minority Report, même s’il existe évidemment de nombreuses différences. La plus évidente d’entre elles : il ne fait pas appel aux « précogs », ces médiums qui pilotent le système dans le film.

A la place, il repose intégralement sur le machine learning. Les chercheurs ont alimenté leur algorithme avec un ensemble de données publiques sur les crimes violents et ceux dits « de propriété » ; il peut ainsi identifier des motifs récurrents qui servent à repérer ces mêmes comportements à l’avenir.

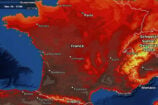

La seconde différence, c’est que cet algorithme ne raisonne pas à l’échelle des individus. Les chercheurs expliquent que leur système fonctionne plutôt sur des bases géographiques ; il livre ses conclusions sur des secteurs d’environ 100 m². S’il était utilisé dans la routine quotidienne des autorités (ce qui n’est pas le cas), il permettrait donc aux policiers de savoir très précisément sur quelles zones se concentrer pour faire baisser le taux d’incidence de ces crimes.

Même s’il ne s’agit que d’une preuve de concept, le système semble fonctionner plutôt bien. Les chercheurs affirment que leur système a réussi à anticiper la prévalence de ces crimes à Chicago dans 90 % des cas, et avec une semaine d’avance !

Une approche “moins biaisée“

Ce n’est pas la première fois que des expériences de ce type apparaissent. On se souvient par exemple du Crime and Victimization Risk Model, une tentative de modèle prédictif à destination de la police de Chicago. Mais les résultats étaient plus que mitigés, avec de nombreux biais et dysfonctionnement.

Ce nouvel algorithme, en revanche, serait plus pertinent que ses semblables. Ces derniers partent souvent du principe que le crime émerge dans certains « points chauds » avant de se répandre aux alentours. Une approche fondamentalement biaisée selon les chercheurs de Chicago.

« Quand des gens s’assoient et déterminent de leur propre chef quels motifs ils vont chercher pour prévoir le crime, c’est difficile de dire qu’il n’y a pas de biais, parce que ces motifs ne veulent rien dire en tant que tel », explique l’un des auteurs cités par Bloomberg.

Il estime que leur approche permet d’éviter cet écueil, puisque leur système met en relation un certain nombre de motifs qu’il identifie par lui-même à l’échelle locale.

L’article de Bloomberg ne précise pas si cette technologie sera utilisée par les forces de l’ordre un jour, ni dans quelle mesure. Ce qui est intéressant, en revanche, c’est que ces travaux ont permis de mettre en évidence certains biais déjà bien connus d’une partie des forces de police.

Les chercheurs expliquent par exemple avoir mis en évidence un phénomène inquiétant ; lorsque le crime augmente dans une zone plus avantagée en termes socio-économiques, les autorités ont tendance à ponctionner des ressources dans les zones déjà démunies. Ce qui fait encore empirer la situation.

Nous ne reviendrons pas sur les conclusions détaillées de ce papier très technique, car elles sont très tortueuses et surtout très américanocentrées. Rappelons que ces travaux proviennent de l’Université de Chicago.

Cette ville aux banlieues minées par la criminalité est aussi un point névralgique de la lutte pour les libertés raciales aux États-Unis. Ces travaux y ont une résonance toute particulière, surtout dans un contexte où la violence policière envers les minorités est l’un des grands sujets du moment. Mais au-delà des biais précis que les chercheurs ont mis en évidence, il y a une autre lecture de la situation qui émerge.

Tel est pris qui croyait prendre ?

Lorsqu’on pense à ces systèmes qui évoquent tout de suite Minority Report, on a souvent tendance à parler des nombreuses problématiques éthiques et sociétales qui y sont associées — et heureusement ! Mal utilisé, un système de ce genre pourrait effectivement faire des ravages avec des biais terribles en fonction de la classe sociale ou de l’origine ethnique, par exemple. Mais le film de Spielberg nous a peut-être conditionnés à ne voir que le mauvais côté de la situation.

Ce qu’on peut retenir de ce papier, c’est avant tout que ces systèmes ne fonctionnent pas que dans un sens. Ils peuvent aussi servir à mettre en évidence des abus et des différences de traitement ! Une approche diamétralement opposée à la philosophie de Minority Report. Dans le film, cette capacité d’anticipation est mise au service d’un pouvoir autoritaire.

Tout n’est donc pas perdu à notre époque où l’IA est plus présente que jamais. Si ces systèmes deviennent la routine un jour, cela signifie aussi que des garde-fous pourront être construits sur les mêmes bases. Tout dépendra donc des humains qui devront négocier ce virage avec délicatesse.

Le texte de l’étude est disponible ici.

🟣 Pour ne manquer aucune news sur le Journal du Geek, abonnez-vous sur Google Actualités et sur notre WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.

Merci pour ces infos.

Juste une mauvaise réaction de ma part à cause de l’utilisation de « sociétale » jamais utilisé pendant au moins 60 ans il semble être devenu le nouveau mot à la mode pour briller, après « perdurer » et autre « problématique » d’ailleurs rarement utilisé dans son sens réel.

Le problème est que même si nos mauvaises réactions sont notre faute, elles nous empêchent de bien profiter des informations suivantes.