Si vous maîtrisez le graphisme digital, vous vous êtes peut-être déjà amusés à vous “photoshopper” dans une photo qui n’a rien à voir. Vous avez alors certainement été confronté au problème récurrent de l’éclairage : pour le rendre cohérent, cela demande du travail et un peu de technique. Mais cela pourrait changer avec avec Total Relighting, un système conçu par Google basé sur le deep learning qui permet de remplacer l’arrière-plan d’une photo. Mais surtout, il se charge de faire correspondre parfaitement l’éclairage de votre photo à l’arrière-plan, quelles que soient les conditions en termes de lumière !

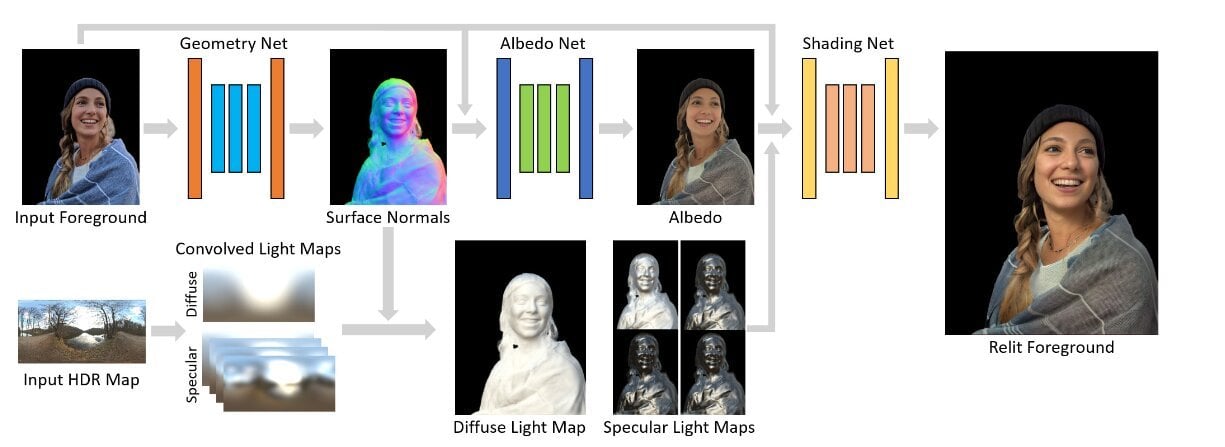

Cette méthode, conçue par des chercheurs de Google, part de deux éléments : un simple portrait standard, pris par n’importe quel appareil, et l’arrière-plan. Cette deuxième image est légèrement plus restrictive, mais rien de dramatique : il va falloir un fichier HDR (à grande plage dynamique). L’intérêt est bien connu des photographes, modélisateurs et compositeurs et autres artistes digitaux. Très grossièrement, grâce à la quantité d’informations sur la lumière capturée dans un format HDR, il est possible de “reconstruire” les conditions lumineuses à l’endroit de la prise de vue.

C’est particulièrement important pour Total Relighting, puisque cette seconde image va servir à la fois d’arrière-plan, mais aussi de source de lumière pour reconstituer l’éclairage.

Une question de cohérence

Avec les techniques traditionnelles de ré-éclairage, on utilise habituellement deux plans, et une image en noir et blanc (que l’on peut appeler calque, masque, matte ou autre selon le contexte) qui gère la transition entre les deux. Cette technique très facile à utiliser est cependant un peu rudimentaire; pour obtenir des résultats réalistes au niveau des ombres et des reflets, il faut la combiner avec d’autres outils et une vraie expertise. Faute de quoi, le résultat apparaîtra peu cohérent et le trucage sera évident.

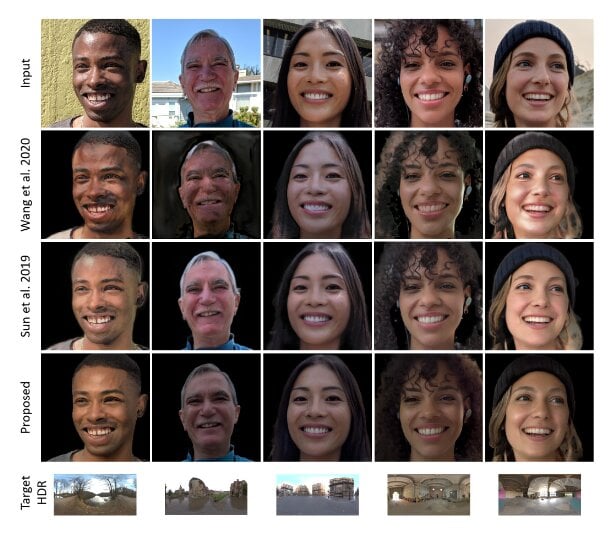

Ici, la lumière du premier plan est recalculée pour être directement à partir de la seconde image ! Elle est ensuite intégrée directement dans l’arrière-plan avec une dernière passe de composition pour harmoniser l’ensemble. Et très honnêtement, le résultat est à couper le souffle. Les ombres sont parfaitement placées et ne débordent pas, les reflets sont parfaits, les changements de teinte sont d’une cohérence bluffante… Mais comment cette équipe est-elle parvenue à un tel résultat sans fournir aucun objet 3D, capable de fournir des informations topologiques indispensables pour une lumière aussi réaliste ?

L’IA en renfort des vieilles techniques

L’ensemble tient en deux mots : neural net. C’est un système basé sur l’intelligence artificielle qui va passer l’image à la moulinette. Il va en tirer ce qu’on appelle une carte normale. C’est un concept omniprésent en 3D : grâce à une image un peu spéciale, on peut définir pour chaque point d’une autre image (par exemple, la texture d’un personnage de jeu vidéo) la perpendiculaire (normale) à la surface, et donc l’angle auquel celle-ci reflète la lumière. Ici, c’est la même idée, sauf que leur algorithme basé sur l’IA calcule cette carte normale sans objet 3D. Il le fait directement à partir de l’image pour simuler le volume de la personne au premier plan, comme s’il était présent en trois dimensions. À partir de ces données, l’algorithme peut recalculer la nouvelle couleur de chaque point pour fournir l’image finale.

On imagine aisément l’intérêt d’un tel outil, dans l’ensemble de l’industrie graphique digitale. Par exemple, cela pourrait grandement faciliter la vie des artistes digitaux qui réalisent des effets spéciaux, qui se battent avec la lumière au quotidien. Avec un tel outil, il suffit de traiter les images en question avec un algorithme de ce genre. Bien plus facile que les techniques traditionnelles, qui impliquent de passer un temps fou à recréer des modèles 3D pour reconstituer un éclairage cohérent qu’il faut ensuite recomposer dans la scène.

Malheureusement, comme à chaque fois qu’une technique permet de s’approcher du photoréalisme, on ne peut pas non plus s’empêcher de s’imaginer les implications au niveau des deepfakes… mais quoi qu’il en soit, c’est une technologie très impressionnante qui pourrait poser les bases d’une petite révolution dans le monde de la composition d’images.

Le papier de recherche est disponible ici.

🟣 Pour ne manquer aucune news sur le Journal du Geek, abonnez-vous sur Google Actualités et sur notre WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.