La reconnaissance faciale est aujourd’hui au centre de nombreuses polémiques. D’un côté, c’est une technologie fantastique avec de nombreux applications concrètes, comme déverrouiller votre smartphone ou votre ordinateur de façon très sécurisée. Certains laboratoires développent également des systèmes permettant de détecter des signes avant-coureurs de certaines maladies neurodégénératives à partir des marqueurs du visage. A plus grande échelle, elle peut également avoir un intérêt en sécurité, par exemple pour intercepter des criminels patentés. Mais malgré ses intérêts potentiels, la reconnaissance faciale globale et généralisée est également reconnue comme l’une des principales menaces potentielles en termes de vie privée et de protection des données personnelles.

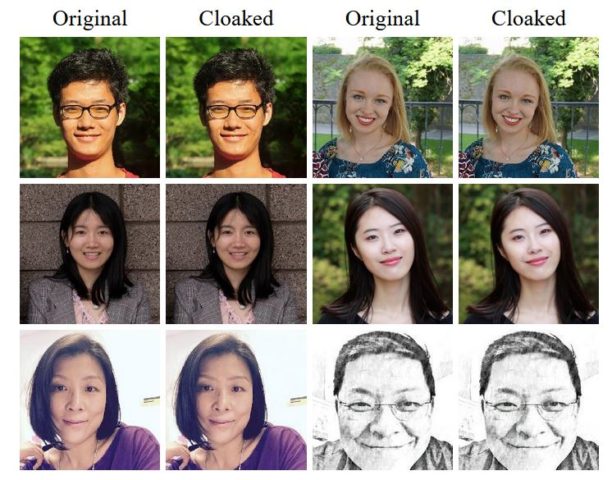

Forcément, le devenir de nos photos sur la Toile pose donc de plus en plus de questions, et c’est tout naturellement que certains organismes développent des solutions pour endiguer cette reconnaissance systématique. C’est le cas de Fawkes, un outil développé par des scientifiques du laboratoire SAND de l’Université de Chicago et téléchargeable ici, qui utilise l’intelligence artificielle pour modifier vos photos de façon très subtile. Mais il ne s’agit pas d’un outil de retouche puisque les photos ainsi générées sont presque indiscernables des originales au premier coup d’œil… en tout cas, pour un humain. Car ces altérations, aussi discrètes soient-elles, font un travail remarquable lorsqu’il s’agit de duper les algorithmes de reconnaissance faciale !

Un “camouflage” contre la reconnaissance faciale

L’objectif est simple : il s’agit de fournir des informations contradictoires aux algorithmes de détection, bien souvent construits sur la base de milliards d’images glanées aux quatre coins du Web. D’après les auteurs, si une image passée par Fawkes est “mangée” par un tel algorithme, il associera ce visage légèrement modifiée à votre identité, et votre “vrai” visage ne sera donc en théorie pas reconnu. Une technique qui tient un petit peu du cheval de Troie, et s’attaque directement à l’intégrité des ensembles de données dont les IA sont non seulement friandes, mais intégralement dépendantes. Et les résultats revendiqués par l’équipe de recherche sont à peine croyables puisque Fawkes a réussi à tromper certains des plus grands services du secteur (Azure Face, Amazon Rekognition, Face++..) avec une efficacité de… 100% ! Bluffant.

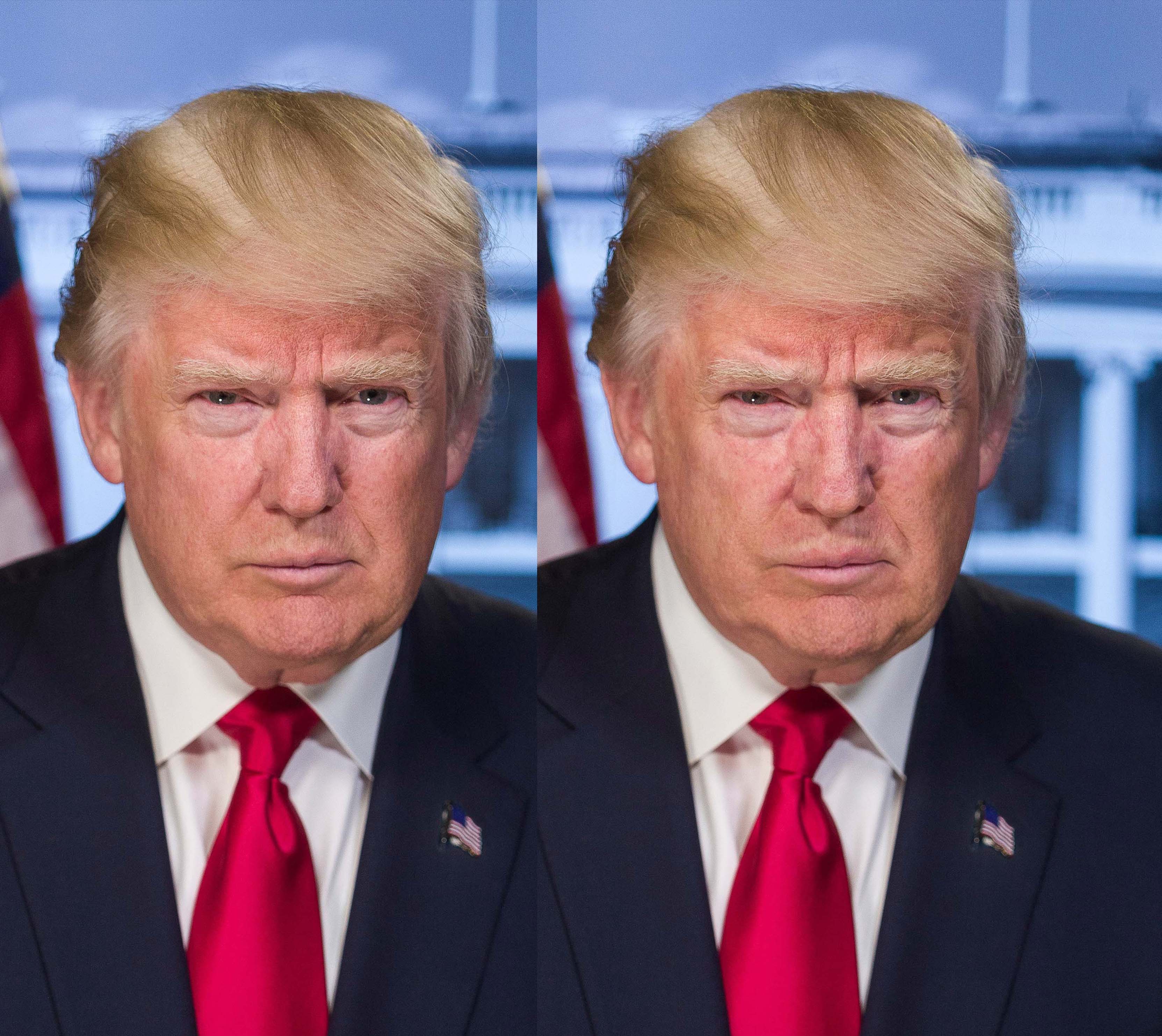

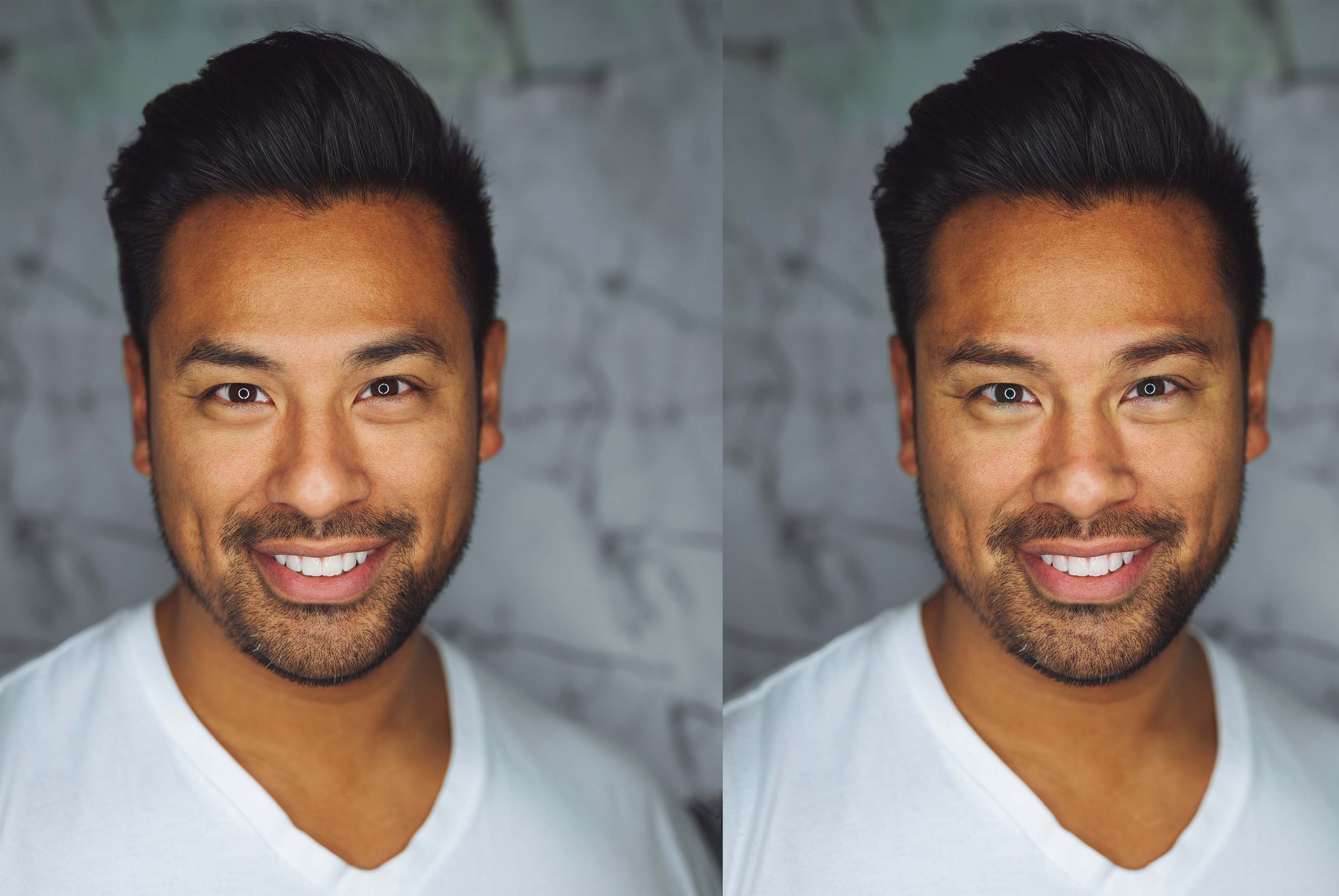

Sur ces quelques exemples, en revanche, on remarque rapidement que quelque chose ne tourne pas rond dans certaines photos modifiées. Jugez-en par vous-même : nous avons fait le test avec le Président des États-Unis et deux anonymes trouvés sur le site de photos libre de droit Unsplash. Si la différence est vraiment minime dans le cadre des deux anonymes, la modification se repère cependant au premier coup d’œil sur la photo de Donald Trump.

D’après Ben Zhao, professeur à l’Université de Chicago ayant participé au projet, “une fois que cette corruption a eu lieu, vous êtes continuellement protégé, où que vous alliez”. Mais on ne peut s’empêcher de prendre cette affirmation avec des pincettes. En effet, pour imaginer corrompre durablement les bases de données des principaux services de reconnaissance faciale, il faudrait certainement les abreuver de photos modifiées avec Fawkes, et cela implique qu’elle soit utilisée massivement, voire intégrée par défaut à différentes applis ou plateformes de partage de photo. Sans parler du fait qu’Internet regorge déjà de milliards de portraits sous formes de pixels, que les algorithmes de deep learning ont déjà eu tout le temps de dévorer et de digérer…

L’équipe de recherche se dit confiante dans la capacité de son produit à impacter les principaux systèmes de reconnaissance faciale, mais admet elle-aussi qu’il faudra certainement un déploiement important pour avoir un réel impact. Pour cela, la voie royale semble toute trouvée : il faudrait que Fawkes se retrouve intégré nativement à des applications photo ou à des réseaux sociaux comme Facebook ou Instagram, auquel cas il pourrait effectivement avoir la portée nécessaire pour agir à grande échelle. Reste encore à optimiser l’algorithme, qui reste relativement lent à l’heure actuelle (une minute par photo sur une machine moyenne) … et à convaincre les grands acteurs du numérique de s’emparer de ce système, ce qui semble très, très loin d’arriver.

🟣 Pour ne manquer aucune news sur le Journal du Geek, abonnez-vous sur Google Actualités et sur notre WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.

Si ils arrivent a bluffer les algorithmes avec si peu de “maquillage” alors on est loin d’avoir peur des dits algorithmes, que même un enfant de 2 ans arriverait a résoudre…

“avec une efficacité de… 100% ! Bluffant. ” ce qui est bluffant c’est la non flexibilité des ces alogo dit “révolutionnairement boosté a l’IA” -_-

Résoudre un algorithme ?